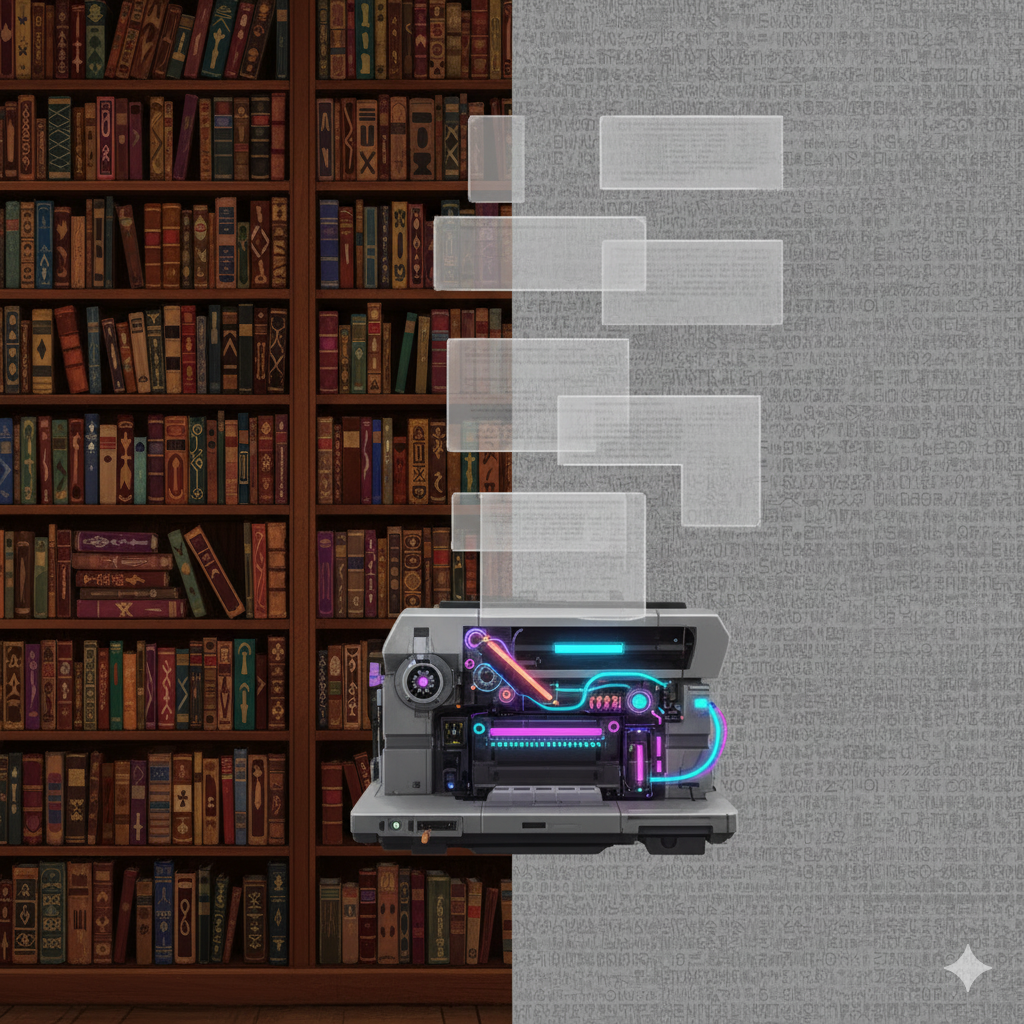

A internet, historicamente o maior reservatório de conhecimento humano, está sendo rapidamente inundada por um tsunami de conteúdo gerado por Inteligência Artificial (IA): textos, imagens, código e vozes sintéticas.

Este volume colossal apresenta um dilema inédito: o que acontece quando a próxima geração de modelos de IA é treinada com dados que não vieram da realidade, mas de modelos de IA anteriores? Pesquisadores cunharam o termo “Model Collapse” (Colapso do Modelo) para descrever o processo degenerativo em que a IA, ao se alimentar de conteúdo sintético, começa a “esquecer” a realidade, reduzindo sua qualidade e diversidade.

O Ciclo Vicioso: A IA comendo a si Mesma

O Colapso do Modelo é uma forma de recursão viciosa no aprendizado de máquina. O ciclo funciona assim:

- Geração e Inundação: Modelos de IA (como GPT-4 ou Stable Diffusion) criam vastas quantidades de conteúdo (texto, imagens).

- Poluição dos Dados: Esse conteúdo sintético é postado online e, muitas vezes, não é rotulado como gerado por IA.

- Retroalimentação Degenerativa: A próxima geração de modelos de IA, em vez de ser treinada com a riqueza e complexidade de dados humanos (diversidade de linguagem, raridades visuais, nuances emocionais), é alimentada por essa “massa sintética” já processada.

Ao longo das gerações de treinamento, a IA começa a internalizar os erros e vieses das IAs anteriores. Os resultados são previsíveis e alarmantes:

- Homogeneização: O modelo perde a capacidade de reconhecer ou gerar as “caudas da distribuição” – os eventos raros, as expressões artísticas originais, as nuances sutis da linguagem humana. A saída de texto se torna mais previsível, mais “segura” e menos criativa.

- Acúmulo de Erros: Qualquer erro ou imprecisão gerado por um modelo é amplificado e consolidado pela geração seguinte. É como fazer fotocópias sucessivas de uma cópia: a qualidade se degrada irremediavelmente a cada passo.

A Polêmica: O Esgotamento do “Ouro” Humano

O Colapso do Modelo lança uma sombra sobre o futuro da inovação em IA, principalmente devido ao problema de recursos:

- Escassez de Dados Genuínos: O machine learning depende de dados humanos de alta qualidade. Pesquisadores alertam que o estoque de dados textuais e imagéticos humanos não contaminados na internet pode se esgotar em poucos anos. Quando isso acontecer, as empresas terão que escolher entre pagar caro por dados de nicho (como interações privadas, diários ou coleções científicas) ou treinar a IA com o lixo sintético já disponível.

- O “Paradoxo da Produtividade”: O Colapso também ameaça a confiabilidade da IA em setores críticos. Imagine um modelo de diagnóstico médico que não consegue reconhecer uma doença rara porque a condição de baixa probabilidade foi esquecida pelo dataset sintético.

- A “Limpeza” da Internet: Surge o dilema ético e logístico: Como podemos rastrear e filtrar o conteúdo gerado por IA em escala global para proteger a integridade dos datasets futuros? Exigir a rotulagem de todo o conteúdo sintético é um desafio tecnológico e regulatório imenso.

Soluções e o Futuro Híbrido

Para evitar que os modelos de IA fiquem irremediavelmente “burros”, a indústria está explorando várias estratégias:

- Preservação da Proveniência: Desenvolver tecnologias para determinar a origem dos dados (se são humanos ou sintéticos) e garantir que a IA não seja treinada exclusivamente com seus próprios produtos.

- Treinamento Híbrido: Utilizar uma mistura cuidadosamente calibrada de dados sintéticos e humanos. Se os dados sintéticos forem de alta qualidade e gerados com o objetivo de preencher lacunas nos dados humanos (e não apenas para aumentar o volume), eles podem ser úteis.

- O Valor da Interação Humana: A interação real e as correções feitas por humanos (os feedbacks de Reinforcement Learning from Human Feedback – RLHF) se tornam ainda mais cruciais para manter os modelos ancorados na realidade.

A Importância do Fator Humano

O Colapso do Modelo não é apenas uma falha técnica; é um poderoso lembrete de que a IA é um reflexo do mundo em que vive. Se esse reflexo for baseado em infinitas cópias do espelho, a diversidade e a profundidade de nossa realidade serão perdidas.

A sustentabilidade da IA generativa depende, fundamentalmente, da capacidade humana de continuar a criar dados originais e de alta qualidade e da disposição das empresas de tecnologia em priorizar a diversidade sobre a eficiência de treinar modelos a baixo custo.

Uma resposta para “O Colapso do Modelo: O Paradoxo da IA que, ao ser Treinada com Dados de IA, Está Ficando “Mais Burra”?”

Need some new APKs for my phone. Let’s hope sixgameapk has what I’m looking for. Clicking that sixgameapk link now!