O ecossistema informacional contemporâneo atravessa uma fase de metamorfose profunda. No horizonte de 2026, a distinção entre a realidade capturada por lentes ópticas e a realidade sintetizada por algoritmos tornou-se um dos maiores desafios para a coesão social e a integridade democrática. A propagação de desinformação, outrora limitada a textos mal escritos ou montagens rudimentares, evoluiu para uma sofisticação técnica capaz de forjar identidades completas, vozes e vídeos hiper-realistas que enganam não apenas o público leigo, mas também sistemas de segurança biométrica.

Nesse contexto, a utilidade pública de um método de verificação rápida transcende a mera etiqueta digital; trata-se de um mecanismo de defesa contra crimes de imagem, fraudes financeiras e manipulação política. A perícia digital forense, tradicionalmente restrita a laboratórios criminais e investigações de alta complexidade, oferece princípios simplificados que, quando aplicados pelo cidadão comum, permitem identificar uma notícia falsa ou um vídeo manipulado em apenas 30 segundos. A análise que se segue detalha o método dos peritos forenses, as bases psicológicas da desinformação e as ferramentas tecnológicas disponíveis para a validação de fatos em tempo real.

A Arquitetura Psicológica da Desinformação

A eficácia das notícias falsas não reside apenas na sua verossimilhança visual, mas na sua capacidade de sequestrar o sistema cognitivo humano por meio de gatilhos emocionais. Estudos realizados pelo Instituto de Tecnologia de Massachusetts (MIT) demonstram que notícias falsas se espalham 70% mais rápido do que as verdadeiras. Esse fenômeno ocorre porque a desinformação é projetada para evocar “paixões” — no sentido psicológico de sentimentos irracionais e convicções profundas — que inibem o pensamento crítico.

Quando um indivíduo se depara com um conteúdo que provoca raiva, medo, indignação ou uma sensação de urgência extrema, o cérebro entra em um estado de “alta excitação emocional”. Esse estado favorece o compartilhamento impulsivo, pois o ato de disseminar a informação serve como uma forma de sinalização social ou de proteção ao círculo de relacionamentos. A desinformação, portanto, funciona como um vírus que utiliza o hospedeiro para sua própria replicação, explorando a necessidade humana de pertencimento e a validação de vieses cognitivos.

Tabela 1: Dinâmica de Gatilhos Emocionais na Desinformação

| Gatilho Emocional | Mecanismo de Exploração Técnica | Impacto no Comportamento Digital |

| Urgência (Scarcity) | Termos como “Urgente”, “Antes que apaguem” ou “Censurado”. | Induz ao compartilhamento sem a leitura completa do conteúdo. |

| Indignação Moral | Relatos de corrupção ou injustiça sem fontes documentais claras. | Gera comentários de reforço e amplificação algorítmica por engajamento. |

| Medo (Fearmongering) | Alertas sobre riscos iminentes à saúde ou segurança financeira. | Estimula o envio para grupos de família como medida de “utilidade pública”. |

| Validação de Viés | Conteúdo que confirma preconceitos sobre oponentes políticos. | Reduz a barreira de verificação, pois o receptor “quer” que aquilo seja verdade. |

O reconhecimento desses gatilhos é o “Passo Zero” do método forense. A primeira recomendação dos especialistas é a interrupção consciente do fluxo emocional: a “pausa de cinco segundos”. Se o conteúdo provoca uma reação visceral, a probabilidade de ser uma peça de manipulação aumenta exponencialmente.

O Método SIFT: Os Quatro Movimentos da Verificação Rápida

Para combater a velocidade da desinformação, Mike Caulfield desenvolveu o protocolo SIFT, uma metodologia de quatro movimentos que permite avaliar a credibilidade de qualquer fonte em segundos. Ao contrário da leitura vertical tradicional (do topo ao fim da página), o SIFT foca na “leitura lateral”, que consiste em investigar a reputação da fonte antes de consumir o seu conteúdo.

Movimento 1: Stop (Parar)

O primeiro movimento é o mais simples e, ironicamente, o mais difícil de executar na era da gratificação instantânea. Ao encontrar um vídeo ou notícia bombástica, o usuário deve parar. O objetivo é evitar o “ciclo de clique” e a queda em “tocar de coelho” informativos. Se você não conhece o site ou o autor, não deve ler ou compartilhar o conteúdo até saber o que ele é.

Movimento 2: Investigate the Source (Investigar a Fonte)

Investigar a fonte não significa realizar uma tese de doutorado sobre o site, mas gastar poucos segundos para entender quem está por trás dele. Peritos utilizam a técnica de abrir uma nova aba e pesquisar o nome do site seguido de termos como “crítica” ou “proprietário”. Se um vídeo sobre os benefícios de um produto é postado por uma conta ligada à indústria desse produto, sua neutralidade deve ser questionada.

Movimento 3: Find Better Coverage (Encontrar Melhor Cobertura)

Muitas vezes, a alegação de uma notícia é mais importante do que o post original. O terceiro movimento consiste em procurar a mesma notícia em veículos de imprensa de referência ou agências de checagem. Se uma celebridade fez uma declaração polêmica, portais de notícias confiáveis certamente terão reportado o fato com o contexto adequado. Se ninguém mais está falando sobre o assunto, a chance de ser mentira é elevadíssima.

Movimento 4: Trace Claims to Original Context (Rastrear ao Contexto Original)

A desinformação frequentemente utiliza mídias reais fora de contexto. Um vídeo de um desastre natural de 2010 pode ser compartilhado como se estivesse acontecendo hoje. Rastrear o conteúdo significa encontrar a postagem original para verificar se a legenda e a data correspondem à realidade. Ferramentas de busca reversa de imagem são fundamentais para este passo.

Perícia Forense Digital: Princípios Aplicados ao Cotidiano

A perícia digital é a ciência que utiliza técnicas especializadas para identificar, processar e preservar evidências digitais para fins judiciais. Embora o laudo pericial exija rigor técnico e validade legal, os seus princípios podem ser adaptados para a verificação rápida por leigos.

O Princípio de Locard Digital

O Princípio de Locard estabelece que “todo contato deixa um rastro”. No ambiente digital, isso significa que toda ação — seja a criação de um vídeo por IA ou a edição de uma foto — deixa vestígios técnicos passíveis de rastreamento. Identificar uma fake news consiste em encontrar esses vestígios, que podem se manifestar como inconsistências visuais, metadados ausentes ou padrões de tráfego anômalos.

Cadeia de Custódia da Informação

Um dos pilares da perícia é a “Cadeia de Custódia”, que garante a integridade da evidência desde a coleta até o tribunal. Para o cidadão comum, aplicar esse princípio significa verificar a “genealogia” da notícia: quem foi o primeiro a postar? O link que você recebeu é o original ou um “encaminhado” sem fonte?. A quebra da cadeia de custódia — a perda da ligação com a fonte primária — é um dos maiores indicadores de que a informação foi manipulada.

Tabela 2: Comparativo entre Leitura Vertical e Leitura Lateral (Forense)

| Característica | Leitura Vertical (Amadora) | Leitura Lateral (Perito Forense) |

| Foco Inicial | O conteúdo e o texto da página. | A reputação da fonte e do autor. |

| Ação Principal | Clicar em links internos do site. | Abrir novas abas para pesquisa externa. |

| Avaliação de Verdade | Baseada no design e tom profissional do site. | Baseada no consenso de fontes independentes. |

| Tempo Gasto | Minutos lendo o artigo completo. | 30 a 60 segundos verificando metadados e origens. |

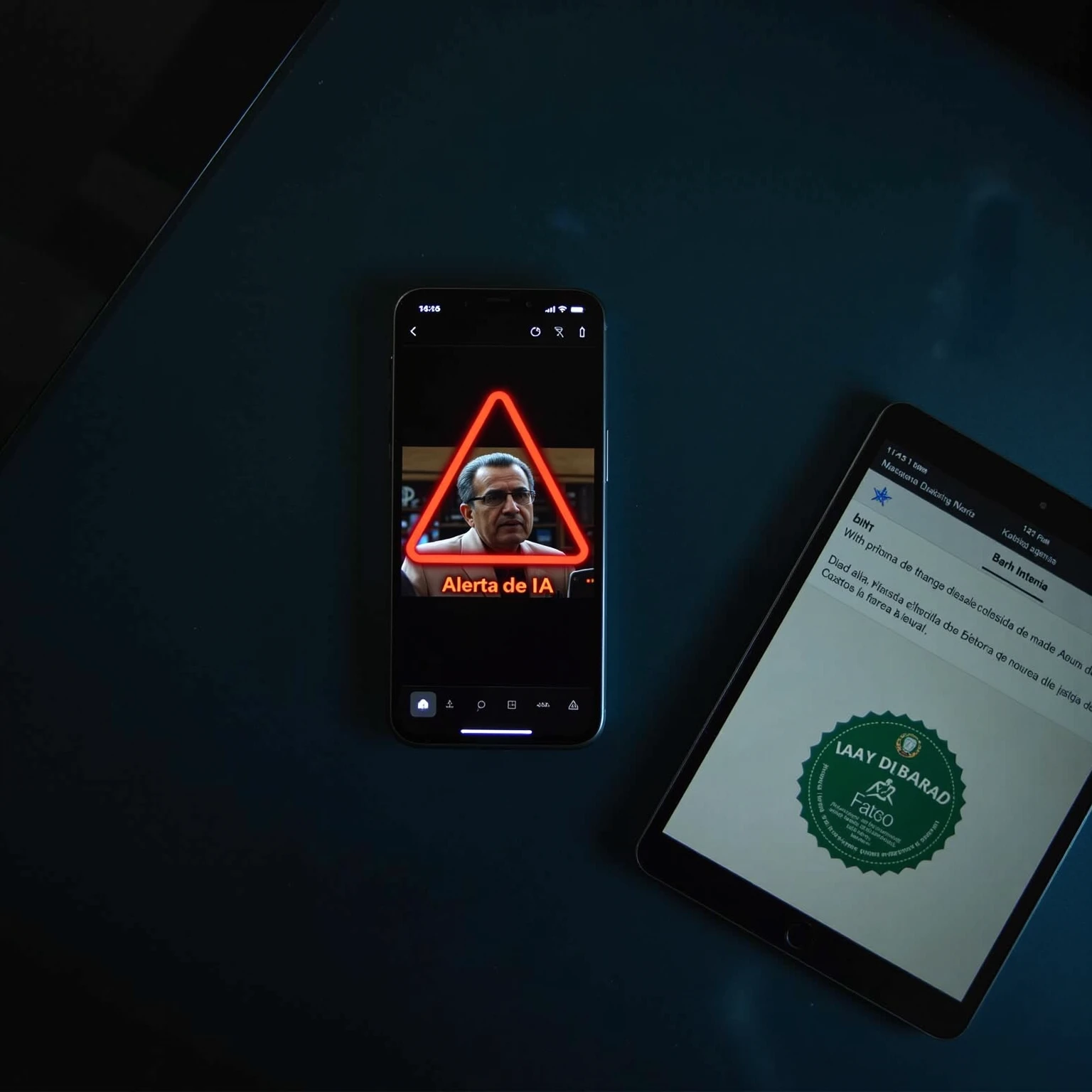

Anatomia do Deepfake: Como Identificar Vídeos e Áudios Sintéticos

Com o advento das IAs generativas em 2025 e 2026, os vídeos falsos atingiram um nível de realismo sem precedentes. No entanto, os algoritmos ainda apresentam dificuldades em emular perfeitamente a física do mundo real e a biologia humana. Identificar esses “artefatos” de IA é a chave para o truque de 30 segundos.

Anomalias Visuais em Rostos e Corpos

A IA generativa, como o StyleGAN3 ou modelos mais recentes de 2026, foca na reconstrução estatística de pixels, o que pode gerar inconsistências geométricas. Peritos recomendam observar:

- O Olhar e a Piscada: A piscada humana é um reflexo complexo. IAs frequentemente falham em replicar a frequência natural da piscada ou criam movimentos oculares que não convergem para o mesmo ponto focal.

- Sincronia Labial (Lip-sync): Em vídeos manipulados, a boca pode se mover de forma levemente dessincronizada com os fonemas emitidos, especialmente em sons explosivos (como ‘p’ e ‘b’) que exigem fechamento total dos lábios.

- Dentes e Língua: IAs têm dificuldade histórica com a anatomia interna da boca. É comum ver dentes em número excessivo, desalinhados ou que parecem se fundir uns aos outros.

- Acessórios e Geometria: Brincos que aparecem em apenas um lado do rosto, hastes de óculos que não terminam atrás da orelha ou sombras que não acompanham o movimento do corpo são sinais clássicos de deepfake.

O Estudo da Royal Society e os Sinais Sutis

Um estudo publicado na Royal Society Open Science no final de 2025 demonstrou que um treinamento de apenas 5 minutos aumenta significativamente a capacidade humana de detectar rostos falsos. O estudo destacou que peritos olham para as “bordas” da imagem: onde o cabelo encontra a testa e onde o pescoço encontra a mandíbula. Nestas áreas, a IA costuma criar um efeito de “halo” ou uma transição suave demais, eliminando poros e imperfeições naturais da pele.

Inconsistências em Áudios Clonados

A clonagem de voz (Voice Cloning) é amplamente utilizada em golpes de engenharia social. Para identificar um áudio falso em segundos, o perito deve atentar para:

- Padrões de Respiração: A IA pode omitir respirações ou colocá-las em momentos não naturais da frase.

- Tom Robótico e Timbre: Embora o timbre seja idêntico, a cadência pode ser excessivamente monótona, sem as microvariações emocionais que um ser humano expressa ao falar sob estresse ou alegria.

- Ruído de Fundo Incoerente: Se a voz parece ter sido gravada em um estúdio silencioso, mas o vídeo mostra a pessoa em um comício ou rua barulhenta, o áudio foi provavelmente sobreposto.

Tabela 3: Check-list de Detecção de Artefatos de IA em Vídeos

| Artefato Visual | Sinal de Alerta (Red Flag) | Descrição Técnica |

| Olhos | Ausência de brilho ou reflexos assimétricos. | A IA falha em calcular a física da luz na córnea úmida. |

| Dentes | Dentes em excesso ou sem gengiva clara. | Erro na modelagem 3D interna da cavidade bucal. |

| Pele | Textura “cerosa” ou excessivamente lisa. | Aplicação excessiva de algoritmos de suavização estatística. |

| Acessórios | Brincos diferentes ou óculos deformados. | Dificuldade da IA em manter a simetria de objetos rígidos. |

| Metadados | Ausência de data, local ou modelo da câmera. | Vídeos sintéticos raramente carregam metadados de hardware real. |

Ferramentas Tecnológicas para Verificação em Tempo Real

A tecnologia que cria a desinformação também fornece as armas para combatê-la. No ambiente mobile, existem ferramentas que permitem realizar uma perícia básica em menos de 30 segundos.

Busca Reversa de Imagens: O Google Lens

O Google Lens é a ferramenta mais acessível para verificar a origem de uma foto ou quadro de vídeo no celular. Ao capturar um print de um vídeo suspeito e jogá-lo no Lens, o sistema vasculha bilhões de imagens para encontrar correspondências. Se a foto for de um evento antigo sendo usada para ilustrar um fato atual, a mentira é exposta instantaneamente.

O Ecossistema de Fact-Checking

No Brasil, agências como Aos Fatos, Lupa, Estadão Verifica e Fato ou Fake consolidaram-se como fontes primárias de verificação. O Google Fact Check Explorer permite pesquisar por palavras-chave e ver se alguma agência ao redor do mundo já desmentiu aquela informação específica. Em 2026, ferramentas como o FactFlow AI monitoram redes como o Telegram em tempo real, reduzindo para segundos a detecção de narrativas falsas virais.

Softwares de Detecção Forense para Vídeos

Para usuários que desejam uma camada extra de segurança, extensões de navegador e sites especializados oferecem análise multimodal:

- InVID: Permite fragmentar vídeos do YouTube, Facebook ou X em quadros e analisar metadados escondidos.

- ElevenLabs AI Speech Classifier: Especificamente desenhado para identificar se um áudio foi gerado pela plataforma ElevenLabs, uma das mais usadas para clonagem de voz.

- DeepSafe: Ferramenta de código aberto (WebApp/Chrome) que usa aprendizagem profunda para detectar mídias manipuladas.

O Desafio das Eleições de 2026 e a Desinformação Algorítmica

As eleições de 2026 no Brasil marcam a primeira disputa presidencial na era da IA generativa popularizada. O Tribunal Superior Eleitoral (TSE), por meio da Resolução 23.732, estabeleceu regras rigorosas que proíbem o uso de deepfakes para simular falas de candidatos, exigindo rotulagem obrigatória para qualquer conteúdo sintético. O descumprimento dessas normas pode levar à cassação do registro ou do mandato do candidato envolvido.

Entretanto, a desinformação em 2026 tornou-se mais insidiosa. Observa-se o crescimento das “Identidades Sintéticas”, onde perfis falsos são criados com vídeos e áudios convincentes para influenciar o debate público de forma coordenada. Além disso, o fenômeno do “Liar’s Dividend” (Dividendo do Mentiroso) torna-se uma ameaça real: políticos podem alegar que vídeos comprometedores reais são, na verdade, deepfakes, aproveitando-se da descrença generalizada do público na veracidade das mídias digitais.

Tabela 4: Matriz de Ameaças de Desinformação para 2026

| Ameaça | Descrição Técnica | Risco Democrático |

| Deepnudes Políticas | Criação de conteúdo íntimo falso para desmoralizar candidatas mulheres. | Afastamento de mulheres da política e danos reputacionais irreparáveis. |

| Robôs de Resposta em Tempo Real | IAs que interagem em lives simulando humanos. | Manipulação da percepção de apoio popular em tempo real. |

| Clonagem de Voz em Massa | Chamadas automatizadas com a voz do candidato para nichos específicos. | Microdirecionamento de mentiras impossíveis de serem rastreadas em massa. |

| Manipulação de Evidência Digital | Inserção de provas falsas em processos judiciais via IA. | Corrupção do sistema de justiça e perda da confiança na prova material. |

Passo a Passo: O Truque de 30 Segundos na Prática

Para não passar vergonha compartilhando fake news, o método dos peritos forenses pode ser resumido em um protocolo de quatro etapas rápidas que qualquer pessoa pode realizar no celular:

- Segundos 0-5: Identifique o Gatilho Emocional. A notícia te deixou furioso ou desesperado? Se sim, as chances de ser falsa são de 90%. Pare imediatamente.

- Segundos 5-15: Faça a Leitura Lateral. Saia do post original. Abra o Google e digite o título da notícia. Veja se portais conhecidos (G1, Estadão, UOL) confirmam o fato.

- Segundos 15-25: Use o Google Lens. Se for uma imagem ou vídeo, faça uma busca reversa. Veja se a imagem é antiga ou se pertence a outro país.

- Segundos 25-30: Verifique os Artefatos de IA. Dê zoom no rosto. A pessoa piscou? O brinco está deformado? A voz combina com o movimento da boca? Se algo parecer “estranho”, é fake.

Este protocolo não requer habilidades técnicas avançadas, apenas uma mudança de comportamento: do consumo passivo para a verificação ativa. No ambiente digital de 2026, a rapidez no compartilhamento é o maior aliado do mentiroso, enquanto a pausa de 30 segundos é a maior ferramenta do cidadão consciente.

Perspectivas de Integridade Digital

A luta contra a desinformação e os deepfakes não é uma batalha que será vencida apenas por algoritmos de detecção, mas pela educação midiática e pelo letramento digital da população. À medida que as IAs evoluem para eliminar seus próprios rastros e simular imperfeições humanas, a confiança mútua na sociedade dependerá da nossa capacidade de aplicar o pensamento crítico e os princípios da perícia forense.

A integridade digital em 2026 exige uma nova “higiene de dados”. O uso de tecnologias como o blockchain para selar a mídia no momento da captura e a implementação de carimbos de tempo imutáveis são caminhos promissores para restaurar a verdade factual. No entanto, até que essas tecnologias sejam universais, o método dos 30 segundos permanece como a defesa mais eficaz e democrática contra a manipulação da realidade. Compartilhar informação é um ato de responsabilidade social; verificar antes de clicar é o primeiro passo para garantir que a tecnologia sirva à verdade, e não à barbárie informativa.